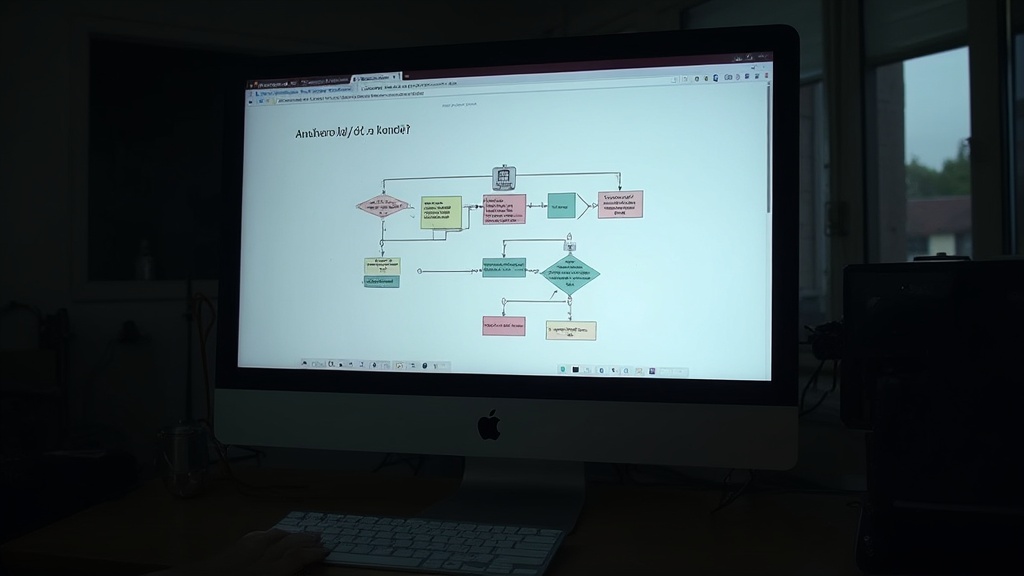

RLHF(Reinforcement Learning from Human Feedback)는 인간 피드백을 활용하여 AI를 개선하는 강화학습 방법론입니다. AI가 인간의 기대에 부합하는 답변을 생성할 수 있도록 돕는 데이터 제작 프로세스가 핵심이며, 이 과정은 Supervised Fine-Tuning, Reward Model 훈련, PPO를 이용한 RL 훈련이라는 세 가지 단계로 구성됩니다.

첫 번째 단계인 Supervised Fine-Tuning에서는 인간이 작성한 질문–답변 세트를 사용하여 모델을 파인튜닝합니다. 모델은 질문과 답변의 패턴을 학습하며 기본적인 언어 이해 능력을 강화하고, 더 자연스럽고 정확한 답변을 생성하는 기반을 다집니다. 두 번째 단계인 Reward Model 훈련에서는 인간이 선호하는 답변을 선택하여 어떤 답변이 더 나은지 학습하는 보상 시스템을 구축합니다.

마지막 PPO를 이용한 RL 훈련에서는 보상 모델이 각 답변에 점수를 부여하고 AI의 정책을 조정합니다. 이를 통해 AI는 다양한 시나리오에서 효과적으로 작동하는 최적화된 의사결정 능력을 갖추게 됩니다. RLHF 데이터 제작 프로세스는 AI를 보다 인간 친화적인 방식으로 발전시키는 필수적인 역할을 합니다.

자연스러운 언어 이해의 기반 마련: 인간이 작성한 질문–답변 세트를 활용하여 기존 언어 모델에 인간 피드백을 반영하는 파인튜닝 과정입니다. 모델이 질문과 답변의 패턴을 학습하며 기본 언어 이해 능력을 강화하고, 이후 단계를 위한 탄탄한 성능 기반을 구축합니다.

인간 선호를 학습하는 보상 체계 구축: 인간이 선호하는 답변을 선택하여 모델이 답변의 질을 평가하는 방법을 학습합니다. 인간 피드백을 통해 보상 시스템을 구축하고, 모델이 인간의 기대에 부합하는 답변을 생성하도록 훈련하는 핵심 단계입니다.

최적화된 정책으로 의사결정 고도화: Proximal Policy Optimization을 통해 보상 모델이 각 답변에 점수를 부여하고 정책을 조정합니다. AI가 더 나은 의사결정을 할 수 있도록 보상 체계를 통해 학습하며, 강화학습의 최종 목표인 최적화된 정책을 수립합니다.

RLHF의 데이터 수집은 인간 레이블러가 작성한 질문–답변 세트를 기반으로 하며, 이 과정에서 약 12,000~15,000개의 고품질 데이터 세트가 생성됩니다. 이 데이터는 Supervised Fine-Tuning 모델 학습에 필수적이며, 모델의 정확성과 신뢰성을 높이는 데 직접적인 역할을 담당합니다.

데이터 정제와 주석 작업은 데이터 품질을 높이기 위한 핵심 과정입니다. 데이터 정제에서는 불필요하거나 오류가 있는 데이터를 제거하여 전체 데이터 세트의 질을 개선하고, 주석 작업은 데이터를 체계적으로 분류하고 설명을 추가하여 모델이 더 정확한 예측을 수행할 수 있도록 돕습니다. 이 두 과정의 철저한 수행이 AI 모델 성능의 토대를 만듭니다.

알고리즘 조정은 데이터 수집과 주석 작업에서 발생하는 오류와 편향을 수정하는 과정입니다. 데이터가 다양하고 복잡할수록 조정의 필요성이 커지며, 이 과정을 통해 모델의 예측 능력을 향상시키고 현실 세계의 다양한 상황에 유연하게 대응하는 능력을 갖추게 됩니다.

데이터 품질은 RLHF의 성공적인 구현을 결정짓는 핵심 변수입니다. 데이터가 정확하고 신뢰할 수 있을수록 AI는 인간의 기대에 부합하는 답변을 일관되게 생성할 수 있으며, 인간 레이블러가 각 답변의 질을 평가하고 피드백을 제공하는 평가 방법론이 모델의 지속적인 성능 향상을 뒷받침합니다.

정확도 평가는 모델의 예측이 얼마나 신뢰할 수 있는지를 측정하는 핵심 도구입니다. 높은 정확도를 유지하는 것이 AI가 실제 환경에서 효과적으로 작동하도록 보장하며, 지속적인 모니터링과 개선을 통해 모델의 실용성을 유지합니다.

데이터 정제는 데이터 세트에서 유해한 내용이나 편향성을 최소화하는 필수 과정입니다. 정제된 데이터는 모델이 보다 객관적이고 공정한 방식으로 학습하도록 이끌며, AI가 다양한 상황에서 적절하게 대응하는 능력을 갖추는 데 직접적으로 기여합니다. 품질 높은 데이터가 곧 신뢰할 수 있는 AI의 조건입니다.

RLHF 방법론은 최근 비전 생성 모델에서도 적용이 시도되고 있으며, AI가 인간의 사회적 기준에 맞게 행동하도록 돕는 방향으로 빠르게 확장되고 있습니다. 기술적 정확성을 넘어 사회적 수용성을 갖춘 AI를 구현하는 데 RLHF가 핵심 역할을 담당하고 있습니다.

인간 피드백 기반의 보상 시스템은 복잡한 시나리오에서 AI의 예측 정교함을 크게 향상시킵니다. 챗봇형 AI에서는 사용자와의 자연스러운 대화를 통해 피드백을 얻고 대화 품질을 지속적으로 개선하는 방식으로 RLHF가 효과적으로 작동하고 있습니다. 적대적 강화 학습과 RLHF의 결합은 AI의 예측 불확실성을 줄이고 일반화 능력을 강화하여 더욱 견고하고 안정적인 성능을 실현합니다.

실무에서는 고객 서비스와 교육 분야에서 RLHF 적용이 활발히 이루어지고 있습니다. 고객의 피드백을 통해 맞춤형 서비스를 제공하고, 학습자의 반응을 기반으로 교육 콘텐츠를 개인화하는 데 RLHF가 활용되며 산업 전반에서 AI의 사회적 수용성을 높이는 중요한 기술로 자리잡고 있습니다.