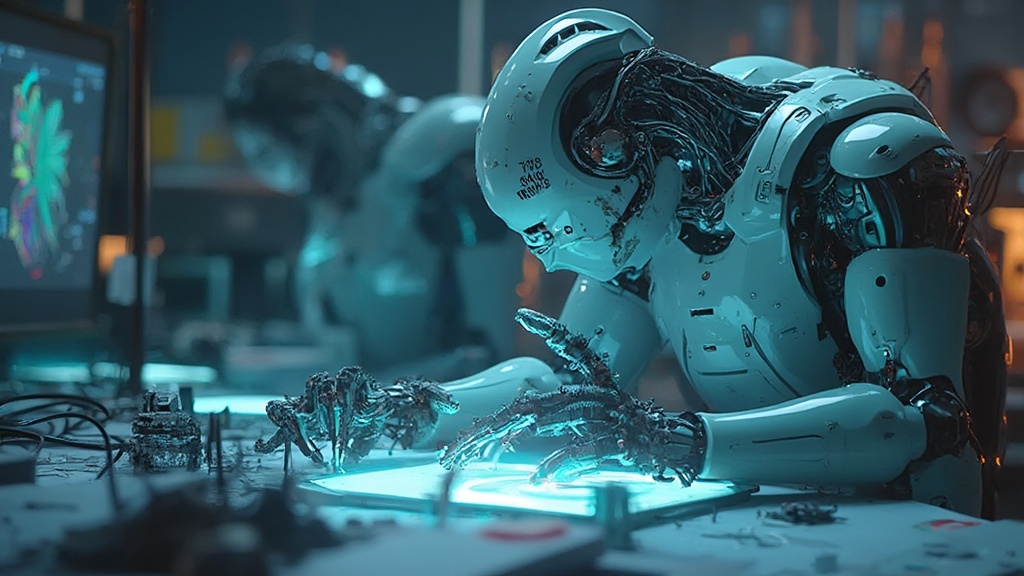

기존의 로봇 비전 시스템은 "객체 탐지(object detection)"에 집중했습니다. 사진 속의 물체들을 식별하고 위치를 파악하는 것입니다. "사과", "테이블", "손"을 각각 탐지합니다. 그러나 현실의 로봇은 물체들이 어떤 관계에 있는지 이해해야 합니다. "손이 사과를 들고 있다", "사과가 테이블 위에 있다", "손이 테이블 위의 사과에 접근하고 있다" 같은 관계를 파악해야 합니다. 객체 탐지만으로는 이러한 관계를 알 수 없습니다.

로봇이 다음 행동을 계획하려면 현재의 "관계 상태"를 이해해야 합니다. "손이 사과에 닿았으므로 이제 집어올릴 수 있다", "다른 사람이 사과에 손을 뻗고 있으므로 지금은 건네줄 준비를 해야 한다" 같은 추론이 필요합니다. 이를 학습하려면 단순한 객체 라벨이 아니라, 물체 간의 공간적 관계(위치, 접촉, 포함), 시간적 관계(어떤 순서로 변했는가), 의도적 관계(왜 이 순서로 변했는가)를 포함하는 데이터가 필요합니다. 장면의 관계 구조를 완전히 표현하는 비전 데이터로 로봇의 장면 이해 수준이 근본적으로 향상될 것으로 예상됩니다.

로봇이 장면을 이해하려면 정지된 이미지가 아니라 장면의 변화 과정을 봐야 합니다. 시간 축과 인과 관계를 포함한 비전 데이터로 로봇이 "다음에 무엇이 일어날 것인가"를 예측할 수 있을 것으로 기대됩니다.

현실의 장면은 항상 완전히 보이지 않습니다. 물체 뒤에 다른 물체가 숨어 있거나(occlusion), 물체의 일부만 보입니다. 로봇이 물체를 집으려면 숨겨진 부분까지 이해해야 합니다. "이 손이 잡고 있는 것은 무엇인가"를 알기 위해 손가락 사이에 보이는 부분만으로도 추론해야 합니다. 또한 부분적으로만 보이는 물체의 전체 모양을 상상할 수 있어야 합니다.

비전 데이터 수집 시 의도적으로 은폐 상황을 포함시킵니다. 물체가 다른 물체 뒤에 숨겨진 상태에서, 로봇 또는 인간이 그 물체를 집으려는 시도를 기록합니다. 또한 부분적으로만 보이는 물체를 로봇이 어떻게 인식하고 상호작용하는지 데이터화합니다. 은폐된 부분의 "가능한 형태"를 여러 개 라벨링하여, 로봇이 불확실성을 처리하는 방법을 학습하도록 합니다. 은폐와 부분 가시성을 포함한 현실적 비전 데이터로 로봇의 장면 이해가 매우 강건해질 것으로 기대됩니다.

비전 시스템이 물체를 "식별"하는 것만으로는 부족합니다. 로봇은 물체의 "기능성(affordance)"을 이해해야 합니다. 컵은 "쥘 수 있고, 들 수 있고, 액체를 담을 수 있다"는 특성이 있습니다. 스푼은 "집을 수 있고, 액체를 떠낼 수 있다"는 특성이 있습니다. 같은 물체라도 로봇의 목표에 따라 다르게 상호작용해야 합니다. 물을 마시기 위해서는 컵을 들어 입에 가져가지만, 물을 옮기기 위해서는 컵을 옆으로 눕혀 담을 수도 있습니다.

비전 데이터에 물체의 기능적 특성을 라벨링합니다. 모양뿐 아니라 "이 물체의 손잡이는 여기에 있다", "이 물체는 채울 수 있는 공간이 있다", "이 표면은 미끄럽다" 같은 정보를 포함시킵니다. 또한 같은 물체가 다양한 방식으로 상호작용되는 장면들을 수집합니다. 물체의 기능성을 포함한 통합적 장면 이해 데이터로 로봇이 맥락에 맞춘 유연한 행동을 학습할 수 있을 것으로 예상됩니다.

로봇이 장면을 이해하는 궁극의 목적은 인간의 의도를 예측하고, 그에 맞춰 행동하는 것입니다. 인간이 냄비를 집어 올렸을 때, 로봇은 "이 인간이 음식을 요리하려고 한다" 또는 "이 인간이 냄비를 씻으려고 한다"를 추론해야 합니다. 비전 데이터에 이러한 의도 정보를 라벨링합니다. 같은 행동도 맥락에 따라 다른 의도를 나타낼 수 있습니다. "냄비를 들고 스토브로 간다" → 요리 의도, "냄비를 들고 싱크대로 간다" → 청소 의도. 또한 장면의 초기 상태로부터 특정 목표 상태까지의 "경로"를 기록합니다. "재료가 테이블에 흩어져 있다" → "재료가 냄비에 들어가 있다" 같은 상태 전이를 기록하면, 로봇이 인간의 작업 계획을 이해할 수 있습니다. 인간의 장기적 의도와 행동 계획을 포함한 장면 데이터로 로봇의 선제적 협력 능력이 크게 향상될 것으로 기대됩니다.

복잡한 장면의 모든 관계를 자연스럽게 학습하기는 어렵습니다. 따라서 관계를 명시적으로 그래프 구조로 표현합니다. 이를 "장면 그래프(scene graph)"라 합니다. 각 물체는 노드이고, 관계는 간선입니다. "손이-사과를-집고-있다" 같은 관계가 간선으로 표현됩니다.

장면 그래프는 여러 수준의 추상화를 포함할 수 있습니다. 저수준 그래프는 "A는 B 위에 있다", "A는 B에 닿아 있다" 같은 공간 관계만 포함합니다. 고수준 그래프는 "A는 B를 지원하고 있다", "A는 B를 방지하고 있다" 같은 기능적 관계도 포함합니다. 비전 데이터 수집 시 영상으로부터 자동으로 장면 그래프를 생성하거나, 인간이 수동으로 라벨링합니다. 명시적 장면 그래프 표현으로 로봇의 장면 추론이 명확하고 검증 가능해질 수 있습니다.

로봇이 현실의 모든 환경에서 작동하려면, 다양한 조명, 각도, 카메라 특성에서 수집된 데이터가 필요합니다. 같은 장면도 위에서 본 각도와 옆에서 본 각도가 다릅니다. 같은 장면도 밝은 조명과 어두운 조명에서 다르게 보입니다. 또한 로봇이 사용하는 여러 종류의 카메라(RGB, 깊이, 열화상)에서 모두 데이터를 수집합니다. 각 카메라 유형은 서로 다른 정보를 강조합니다.

RGB 카메라는 물체의 색상과 질감을 잘 보여주고, 깊이 카메라는 물체 간의 거리를 정확히 나타냅니다. 데이터 수집 시 의도적으로 다양한 조건과 시점을 포함시킵니다. 같은 작업을 여러 각도에서, 여러 조명 조건에서, 여러 카메라로 기록합니다. 다양성 높은 비전 데이터로 로봇의 장면 이해가 환경 변화에 견고해질 것으로 예상됩니다.

현실에서만 데이터를 수집하는 것은 비용이 많이 들고, 위험한 상황을 실제로 재현하기 어렵습니다. 따라서 시뮬레이션으로 생성된 장면 데이터도 활용합니다. 시뮬레이션은 무한한 다양성을 제공합니다. 같은 장면에 물체를 추가하거나, 조명을 변경하거나, 관점을 바꾸는 것이 순식간에 가능합니다. 또한 위험한 상황(화재, 폭발, 낙상)을 안전하게 시뮬레이션할 수 있습니다. 다만 시뮬레이션 데이터와 현실 데이터 간의 시각적 간격(domain gap)이 존재합니다. 시뮬레이션의 렌더링 방식이 현실과 다르기 때문입니다. 이를 극복하기 위해 도메인 적응 기법을 사용합니다. 시뮬레이션 이미지를 현실처럼 변환하거나, 현실 이미지에 시뮬레이션의 장점을 더합니다. 시뮬레이션과 현실의 효율적 결합으로 대규모 장면 이해 비전 데이터를 경제적으로 구축할 수 있을 전망입니다.